Imaginando o futuro

Era uma vez, a inspeção visual da infraestrutura submarina significava que mergulhadores levavam as câmeras para o fundo do mar, na esperança de que o invólucro da câmera não fosse inundado, ou que o filme não fosse exposto ou destruído durante o desenvolvimento. Mesmo usando os primeiros veículos operados remotamente (ROV) com uma transmissão de vídeo ao vivo, era difícil ter visão suficiente de um alvo de inspeção, devido ao controle limitado e à funcionalidade de posicionamento se houvesse algum nível de corrente.

É seguro dizer que a indústria já percorreu um longo caminho desde então e as possibilidades de imagem estão se expandindo a cada dia. Na verdade, o problema agora está começando a se tornar como processar o “tsunami” dos dados que estão sendo coletados.

Essas questões estavam no topo da agenda em um seminário conjunto realizado pela Sociedade Hidrográfica da Escócia (THSiS), pela Associação Internacional de Empreiteiros Marítimos (IMCA) e pela Sociedade de Tecnologia Subaquática (SUT), em Aberdeen, em outubro.

Por um lado, as plataformas de sensores estão evoluindo. Ambos os ROVs e veículos subaquáticos autônomos (AUV) estão se tornando mais rápidos de usar; A BP tem como meta ter 100% de inspeção submarina realizada por meio de sistemas autônomos marinhos (MAS) até 2025, disse Peter Collinson, especialista submarino sênior e ambiental da BP na petrolífera, no seminário.

Eles também estão se tornando mais autônomos, apoiados por centros de operações onshore. A Equinor já testou as operações de ROV de pilotos a partir de centros onshore (via Oceaneering e IKM) e este ano ele vai testar o robô submarino de Eelume em uma garagem submarina no campo de Åsgard, na costa da Noruega. Em 2020, espera não perder a força, disse Richard Mills, diretor de vendas da Kongsberg Maritime Robotics, ao seminário. O próximo passo poderia ser usado em combinação com vasos de superfície não tripulados.

Enquanto isso, as tecnologias de imagem, do laser à fotogrametria, estão ajudando essas plataformas a coletar mais dados, mais rapidamente e, potencialmente, também ajudá-los a navegar.

Operações de pesquisa submarina usando um sistema ORUS3D. (Fonte: Inovação Comex)

Operações de pesquisa submarina usando um sistema ORUS3D. (Fonte: Inovação Comex)

Pretty - mensurável - fotos

Pesquisas on-the-fly estão sendo feitas usando fotogrametria. No verão de 2018, a Comex Innovation concluiu dois projetos de inspeção offshore do Mar do Norte usando sua tecnologia de fotogrametria subaquática ORUS3D, tendo anteriormente feito projetos na África Ocidental, Raymond Ruth, UK e North Sea Agent para Comex Innovation. Ambas as operações, nos setores britânico e dinamarquês do Mar do Norte, exigiam medições de alta precisão, uma em apoio a modificações brownfield.

O sistema óptico submarino ORUS3D mede e depois cria modelos 3D de alta resolução de estruturas submarinas. Cada sistema compreende um feixe integrado de sensores tri-focais, com quatro unidades de flash LED de feixe largo, além de uma unidade de aquisição e processamento de dados. Ele usa triangulação de recursos dentro das imagens capturadas para localizar sua posição relativa e construir uma reconstrução da nuvem de pontos 3D que pode ser usada para medição, de modo que um sistema de navegação inercial ou colocação de destino no objeto para dimensionamento não são necessários quando no local.

A unidade integrada se ajusta a um ROV para aquisição de dados em vôo livre a mais de 40 cm de distância das estruturas, embora a melhor distância esteja entre 1 a 2 metros do objeto. Isso não leva mais que uma pesquisa em vídeo geral, disse Ruth.

O processamento inicial a bordo em tempo real é realizado para avaliar a localização e a qualidade, antes do processamento no local (no navio de suporte), para conferir qualidade adicional aos dados e criar um modelo 3D dimensionado inicial com precisão de cm. O processamento final dos dados, que são coletados como dados de nuvem de pontos, é então realizado para reconstruir o site ou objeto em um modelo 3D com precisão de mm.

Resultados de uma pesquisa da ORUS3D (fonte: Comex Innovation)

Resultados de uma pesquisa da ORUS3D (fonte: Comex Innovation)

Eventos automáticos

A EIVA vem trabalhando no uso de aprendizado de máquina e técnicas de visão computacional para detectar objetos como anodos no tubo, danos nos tubos e crescimento marinho automaticamente, usando uma câmera convencional, disse Matthew Brannan, pesquisador sênior da EIVA. Usar o aprendizado de máquina significa ter que treinar um sistema com dezenas de milhares de imagens de oleodutos. É o que a EIVA vem fazendo e está dando frutos. A empresa executou testes em conjuntos de dados existentes que foram processados da maneira tradicional, portanto, foi possível comparar os resultados automatizados com os eventos feitos pelo homem. No final de 2018, também iniciou testes ao vivo durante operações baseadas em ROV. O objetivo final da tecnologia é o reconhecimento automático de eventos durante uma pesquisa de AUV, permitindo que um AUV detecte algo e envie uma mensagem para um navio de superfície, disse Brannan.

A EIVA também está levando câmeras convencionais ainda mais, usando localização e mapeamento simultâneos (SLAM) e fotogrametria para fazer áreas de mapas, enquanto consegue localizar a posição da câmera em relação ao que está mapeando. Os sistemas SLAM existentes dependem do fechamento de loop, e as soluções de fotogrametria precisam de muita sobreposição de imagem e boa visibilidade, e geralmente não são em tempo real, explicou Brannan. Alguns também contam com câmeras estéreis caras, que precisam de calibração e ocupam espaço, disse ele.

EIVA chama seu sistema VSLAM, ou visual SLAM. Criando uma nuvem de pontos esparsos em tempo real, o VSLAM pode se localizar (ou seja, o veículo em que está) em seu ambiente e usar o modelo que está criando para rastrear e verificar automaticamente estruturas submarinas. Isso é possível com uma única câmera, disse Brannan, e de imagens estáticas ou imagens extraídas de vídeo, rastreando pontos em cada imagem e estimando uma trilha, usando esses pontos, para construir a nuvem de pontos esparsa, criando um modelo de terreno digital. Um AUV também saberia sua posição absoluta original e poderia então usar waypoints (isto é, pontos de referência) ao longo da rota.

A nuvem de pontos pode ser usada para criar uma densa nuvem de pontos 3D e, em seguida, uma malha, com cor e textura adicionadas. A EIVA tem uma equipe trabalhando nisso desde 2017 e agora está testando o sistema em AUVs. Este ano, será executado projetos ao vivo, com navegação visual, disse Brannan, e seguindo isso, quer ajudar na inspeção autônoma e na intervenção de luz.

subSLAM

A Rovco tem a visão de implantar um AUV com um veículo de superfície autônomo (ASV) para realizar pesquisas e mapeamento com sua tecnologia de mapeamento e imagem 3D ao vivo da SubSLAM. O SubSLAM permite que um ROV crie um mapa 3D de seu ambiente em tempo real, sem usar outros sistemas inerciais de navegação ou posicionamento. A empresa chama isso de visão computacional 3D ao vivo.

Conceito SubSLAM ao vivo da Rovco (Fonte: Rovco)

Conceito SubSLAM ao vivo da Rovco (Fonte: Rovco)

A tecnologia de câmera inteligente SubSLAM X1 da Rovco usa um sistema de câmera dupla para criar uma nuvem de ponto ao vivo do que vê. Isto é então usado para calcular a posição do veículo em relação ao que ele está olhando.

A Rovco tem usado o SubSLAM em um ROV de observação Sub-Atlantic Mojave, mas está tornando-o compatível com outras plataformas, disse Joe Tidball. A empresa planeja adquirir seu primeiro AUV, um Sabertooth, da Saab Seaeye, este ano, integrando a SubSLAM em 2020 e, em seguida, criando inteligência artificial (IA) no sistema em 2021. A empresa pretende fornecer pesquisas de um ASV a partir de 2022.

Tidball disse que o sistema é adequado para metrologia submarina e pode ser usado com um veículo sem fio usando comunicação acústica, conectado a um gateway de comunicação de superfície com redes de rádio / celular ou satélite e depois para a nuvem, onde engenheiros poderiam acessar uma ferramenta de medição baseada em navegador. - sendo alimentado com dados 3D ao vivo. Com AI, o veículo poderia então fazer avaliações em si.

A Rovco testou seu sistema SubSLAM na Offshore Renewable Energy Catapult em Blyth, no nordeste da Inglaterra, em agosto de 2018. Tidball disse que a empresa testou a precisão de medição que poderia obter usando dados de levantamentos terrestres em estruturas em um dique seco, que foi inundado para que a SubSLAM faça seu trabalho em 1,2m de visibilidade. Os dados subaquáticos foram comparados com uma varredura a laser. Comparado com as duas horas tomadas para fazer uma pesquisa ao ar livre, com erro de alinhamento de 1,7 mm, o SubSLAM obteve 0,67 mm de erro, a partir de uma varredura de dois minutos, disse Tidball.

Tidball disse que o sistema poderia anular a necessidade de sistemas de linha de base longa (LBL), para precisão de posicionamento, mas disse que a visibilidade é um fator importante para as câmeras funcionarem. Embora a tecnologia seja capaz de posicionar o ROV ou o AUV dentro de seu ambiente, se ele estivesse se movendo para outro local e fosse destituível, a navegação inercial seria necessária.

De volta para o Futuro

As técnicas usadas para criar nuvens de pontos em tempo real também podem ser usadas para criar nuvens de pontos a partir de imagens existentes ou imagens de vídeo, disse o Dr. Martin Sayer, diretor administrativo da Tritonia Scientific, sediada na Escócia. Como exemplo, a Tritonia usou sua tecnologia como parte de uma análise líquida de benefício ambiental de uma jaqueta de plataforma em um local tropical, onde um operador queria determinar quanto peso extra o crescimento marinho acrescentaria a uma jaqueta, para levantar cálculos de operação e descarte em terra. planejamento. Tritonia recebeu imagens de ROV existentes para avaliar. Isso foi feito para pesquisas sobre a vida dos peixes, e não para a incrustação biológica da jaqueta, por isso não foi projetado ou destinado à modelagem 3D. Duas câmeras HD e uma câmera padrão foram montadas no ROV, esquerda, direita e central.

Devido à luz na água e a maior parte das imagens sendo direcionadas ao peixe, cerca de 95% não eram utilizáveis. O restante foi filmado durante a noite, tornando-o mais adequado, sem interferência de superfície e melhor contraste, permitindo que uma seção inteira completa da perna seja modelada. Removendo o volume de perna conhecido do modelo, o volume de crescimento marinho pode ser calculado.

No vôo

Para alguns, o real potencial de toda essa tecnologia é poder processar dados ao vivo e usar essas informações para realimentar sistemas autônomos ativos (embora supervisionados).

Há um loop de feedback que tornará essas operações mais poderosas. “Processar os dados [que coletamos] automaticamente é quando obtemos valor”, disse Nazli Deniz Sevinc, líder de projeto da uROV, OneSubsea. “Além disso, [é] um ciclo de feedback em algoritmos de autonomia supervisionada e detecção de recursos”, como discutido por Brannan.

Muita coisa está acontecendo. Autonomia supervisionada, detecção de falhas autônomas, operações não tripuladas, sem a necessidade de embarcações de apoio, são o objetivo. Existem obstáculos, como a legislação, que, na área de sistemas de embarcações não tripuladas, está por trás da tecnologia disponível. Há problemas com padrões de dados e como lidar com a quantidade de dados que estão sendo criados agora, e não menos adaptando essas técnicas aos fluxos de trabalho atuais (ou adaptando os próprios fluxos de trabalho). É um espaço de movimento rápido para assistir com uma enorme quantidade de limites de desfocagem (se não imagens).

Tsunami de dados

Novas tecnologias de imagem estão criando novas oportunidades para visualização e autonomia submarina. Eles também estão criando um desafio de “tsunami de dados” para os operadores. Peter Collinson, da BP, disse: “Uma das maiores preocupações é que quando você começar a enviar frotas de AUVs por aí, teremos um tsunami de dados chegando até nós. Temos nos concentrado nas plataformas [sensor / survey], porque ainda estamos construindo confiança no que esses sistemas são e no que eles podem fazer. O pedaço de dados está chegando ... lidando com esses dados em tempo hábil. Como formamos um gêmeo digital e passamos para a detecção automatizada de mudanças temporais em séries temporais? ”

Embora a coleta de dados evolua rapidamente, o foco futuro está na entrega de dados para as pessoas que precisam dela, como engenheiros de pipeline, em um formato que seja significativo e útil. A inteligência artificial (IA) ajudará, disse Malcolm Gauld, da Fugro, usando a computação em nuvem e detectando automaticamente anomalias ou defeitos. Mas levará tempo para desenvolver sistemas, disse ele. Fugro está trabalhando nisso e vem realizando testes em Perth, que ajudaram a levantar problemas com a IA, como diferenciar um revestimento de tubulação prateado de um tubarão. Passos futuros incluem a construção de autonomia para essa IA. Mas Gauld sugeriu que os novos modelos também deveriam ser analisados. Os pipelines poderiam ser construídos com sensores, tornando-os "inteligentes" desde o início, com toda a previsão de manutenção, ele perguntou. "No futuro, não será sobre o equipamento que você usa para obter esses dados, mas o que você obtém desses dados."

De fato, no futuro, nem sequer estaremos analisando esses dados, sugeriu Joe Tidball, pesquisador sênior da Rovco. Inteligência artificial, robótica, fará a interpretação e tomada de decisão. “Eu não acho que em 10 anos estaremos vendo mais vídeos. Nós simplesmente receberemos relatórios por e-mail de robôs no Mar do Norte dizendo que você precisa olhar para XYZ. ”

Inspeção Rápida de Oleoduto

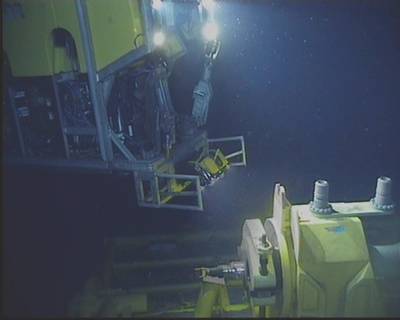

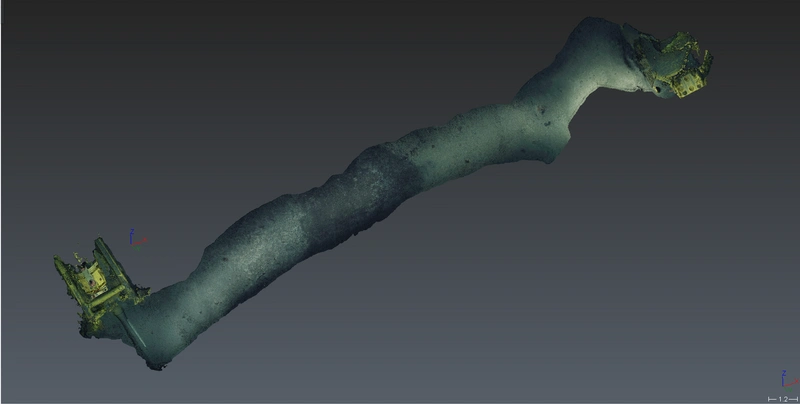

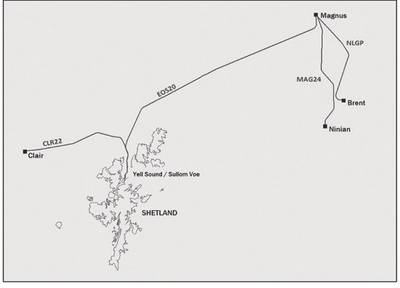

Para pesquisas de pipeline, a BP tem se concentrado em fazer as coisas mais rapidamente. Em 2017, a BP contratou DeepOcean, usando um “ROV Rápido” (foto acima, ROV Superior da Kyst Design da Noruega) para pesquisar 478km de dutos (mapa abaixo), entre as instalações de Clair e Magnus no Mar do Norte para o Terminal Sullom Voe, em terra Shetland, e das instalações de Brent e Ninian para Magnus, tudo em pouco menos de quatro dias. A pesquisa incluiu câmeras fotográficas a laser, HD e sistemas de levantamento de proteção catódica gradiente de campo (FIGS) e tempo médio de inspeção de 5,1kt / hora, 6x mais rápido que um ROV padrão e 5x mais rápido que um ROV padrão modificado, disse Collinson. . Também incluiu dados de pesquisa de varredura lateral e multifeixe. O resultado final foi um arquivo de camada de cena 3D, um mosaico georeferenciado 2D e listagens de evento / anomalia.

Um projeto de Kyst Superior ROV sendo implantado para o levantamento de gasodutos da BP pela DeepOcean (Fonte: BP)

Um projeto de Kyst Superior ROV sendo implantado para o levantamento de gasodutos da BP pela DeepOcean (Fonte: BP)

O sistema de gasoduto pesquisado ao longo de quatro dias (Fonte: BP)

O sistema de gasoduto pesquisado ao longo de quatro dias (Fonte: BP)

Uma seção de pipeline imaginada na pesquisa (Fonte: BP)

Uma seção de pipeline imaginada na pesquisa (Fonte: BP)

Acústica de alongamento

A empresa Schlumberger OneSubsea está trabalhando em um projeto chamado uROV. Seu objetivo é um veículo submarino residente autônomo, com autonomia supervisionada, o que significa ser capaz de se comunicar via vídeo com o veículo da costa. Mas, enquanto a disponibilidade de redes celulares 4G offshore está abrindo comunicação de vídeo através do ar, através de links de vídeo de água não são tão fáceis, Nazli Deniz Sevinc, líder de projeto da uROV, OneSubsea, disse à Sociedade de Tecnologia Subaquática (SUT), Marine Internacional Contratante Association (IMCA) e da Sociedade Hidrográfica da Escócia (THSiS) seminário conjunto em outubro.

O programa uROV da OneSubsea planeja usar um veículo Saab Seaeye Sabertooth, montado com tecnologias Schlumberger. A visão da uROV está em algum lugar entre um ROV operado manualmente e um AUV, oferecendo autonomia sem restrições, mas supervisionada, disse Sevinc. Isso envolveria ter um “humano no circuito”, enquanto ele trabalha a distâncias de até 3 km de um gateway de comunicação de superfície, por exemplo. uma superfície não tripulada. Quando infra-estrutura submarina próxima, também teria um link de dados de até 200m através da água.

Isso permitiria o acesso a veículos submarinos 24/7. Mas, isso significa a necessidade de Wi-Fi submarino, detecção avançada, sensoriamento visual, controle avançado e análise automática. Sevinc disse que a uROV usaria EIVA Navisuite, para planejamento de missões, e uma camada de autonomia desenvolvida para a Sabertooth. Mas, isso depende de feedback em tempo real, que depende de comunicações.

Para operações brownfield, a uROV tem como alvo comunicações acústicas, o que inerentemente significa uma baixa taxa de dados. A OneSubsea, através da sua base de Boston, a Schlumberger, tem trabalhado na quantidade de dados que pode extrair através de 100kpbs. Em 2017, a Sevinc disse que a empresa conseguiu transferência de vídeo de barco para barco por meio de um canal acústico a 100kbps em 1km. Em seguida, obteve resultados semelhantes com uma transferência vertical. Sevinc disse que este é um limite superior para o vídeo, com a largura de banda restante sendo usada para comandos. Ao longo de 2018, essa capacidade estava sendo integrada à uROV, com planos de desenvolver capacidade de transferir dados de vídeo por meio de três quilômetros este ano e implementações reais até o final do ano. Outro kit sendo integrado à uROV inclui a tecnologia laser LiDAR (detecção e alcance de luz) de 3D em Profundidade.

-168002)

-167856)

-167623)

-167415)

-167178)

-166941)